导读包括第一作者、中国浙江大学的周倩薇博士和资深作者、匹兹堡大学的山东吴博士在内的一个团队发现,一个人工智能模型被超过三分之二的假乳房

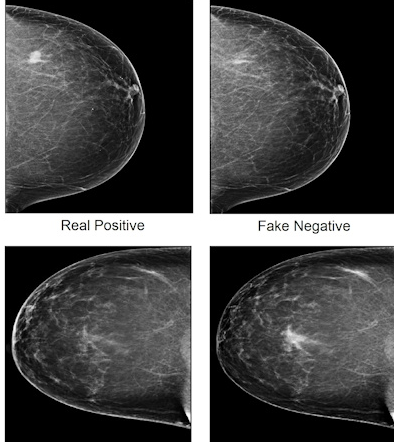

包括第一作者、中国浙江大学的周倩薇博士和资深作者、匹兹堡大学的山东吴博士在内的一个团队发现,一个人工智能模型被超过三分之二的假乳房图像所欺骗,使它们容易发生网络攻击并强调人工智能安全措施的必要性。

“从诊断的角度来看,诊断敏感内容的成像特征对于研究人员和临床医生构建强大和安全的医学成像诊断 AI 系统具有特别的相关性和重要性,”吴告诉AuntMinnie.com。

近年来,人工智能作为第二个读者检测乳腺癌的潜力有所增加,研究表明两者可以在临床环境中共存。

然而,人工智能也面临网络攻击的风险,例如基于生成对抗网络 (GAN) 算法的攻击。可以在图像中添加难以察觉的噪声,可以添加新图像来替换真实图像,或者可以对真实图像进行有针对性的修改。研究人员表示,当将篡改的图像输入 AI 模型时,这些攻击可能会导致意外、错误或错误的诊断结果。

Zhou 等人想了解 AI 在这些复杂的对抗性攻击下会如何表现,使用乳房 X 光照片来开发检测乳腺癌的模型。该研究的作者称其为人工智能对似是而非的对抗性攻击的安全评估的“关键测试”。

他们写道:“了解 AI 诊断模型在对抗性攻击下的行为将有助于获得有关识别网络安全漏洞和开发潜在防御此类攻击的机制的重要见解。”